Griptape, el movimiento de The Foundry que todos esperábamos

¿Nace la competencia de ComfyUI?

Hola a tod@s, gracias por estar aquí de nuevo.

He estado un tiempo en silencio, liado con trabajo y pruebas, pero vuelvo con un tema que merece post.

Ayer por la noche me acostaba con la noticia de la adquisición de GripTape por parte de The Foundry.

Creo que no soy el único que se venía preguntando porque The Foundry estaba tardando tanto en reaccionar a la nueva ola de la IA generativa.

Bien es verdad que había implementaciones de ComfyUi para Nuke desarrolladas por la comunidad pero realmente no ofrecían nada realmente funcional. Los que lo hemos probado hemos sufrido las dificultades de conexión y el poco empaque de estos intentos, merecía mas la pena volverse a Comfy que ejecutarlo dentro de Nuke.

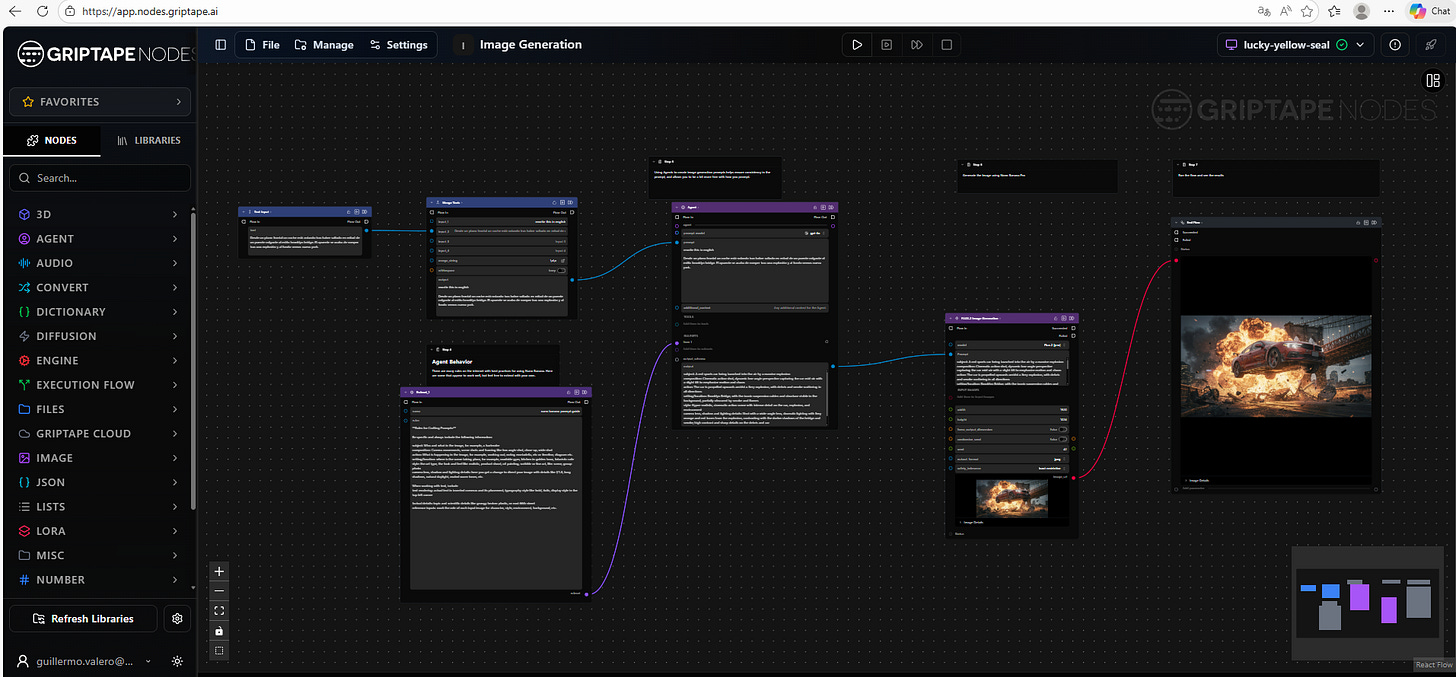

1. ¿Qué es Griptape y qué son Griptape Nodes?

Para situarnos:

Griptape es un framework open source orientado a la construcción de aplicaciones de IA basadas en LLMs (Large Language Models). Está pensado más para desarrolladores que para artistas: orquestación de agentes, flujos de trabajo, integración con herramientas externas, memoria, etc.

Hasta aquí, nada que nos suene especialmente a VFX.

Lo interesante viene con Griptape Nodes:

una capa visual, basada en sistemas de nodos, que permite construir workflows de IA de forma gráfica, muy en la línea de lo que ya conocemos en herramientas como ComfyUI

Para cualquiera que venga del mundo de los VFX, esto es inmediatamente familiar. No es casualidad: el paradigma de nodos es la forma natural en la que pensamos los pipelines complejos.

2. Qué está haciendo realmente The Foundry (y por qué esto es estratégico)

Foundry no está comprando “otro generador” ni “otro modelo”. Está comprando la capa que falta para que la IA sea usable en un estudio sin que se rompa todo lo demás: orquestación.

La IA ya estaba dentro de Nuke como Copycat o The Cattery pero con un enfoque de resolver taras concretas dentro de un plano o secuencia de planos.

Con Griptape, el enfoque cambia:

Pasamos de features sueltas → a pipeline.

Hablan literalmente de “AI-powered features” + “critical orchestration capabilities” y de construir un “AI-first pipeline of the future”. Traducido: esto ya no va de un nodo que hace X, sino de cómo conectas X con el resto del sistema.

El problema real: control, seguridad y trazabilidad.

En cuanto un estudio deja de “probar cosas” y quiere meter IA en producción diaria, aparecen siempre los mismos fantasmas:

quién puede usar qué modelo, con qué datos, qué queda registrado, qué sale fuera, qué entra, qué se versiona, qué es reproducible.

En la nota lo nombran tal cual: control + seguridad + trazabilidad como requisito de “major production environments”.

“Controlled access” a modelos open source y comerciales.

Esto es clave: Griptape no se casa con un modelo. La idea es que el estudio pueda orquestar varios modelos y agentes, e ir cambiándolos sin reventar el workflow cada vez que el ecosistema gira (que gira cada 2 días...)

Integración con Nuke (y, por extensión, con tu toolset real).

No lo dejan en abstracto. Dicen que lo integrarán con herramientas creativas “including Nuke”.

O sea: no quieren que la IA viva en una web externa, quieren que viva en el mismo entorno donde se toman decisiones y se finalizan planos.

Arquitectura Python, extensible y pensada para durar.

Esto me parece de las frases más importantes: “highly extensible Python-based architecture designed for scale, workflow longevity, and integration with existing infrastructure”.

“Workflow longevity” es una forma elegante de decir: no queremos otro juguete que se queda obsoleto en 3 meses; queremos infraestructura.

Hand-offs a producción y granja.

También mencionan integración con “production management and render farm hand-offs”.

Esto no es menor: están pensando en IA como algo que entra en la cadena industrial (colas, granja, automatización, aprobaciones), no como un botón local en la máquina de un artista.

Agentes programables más allá del chat.

Otro punto muy “enterprise”: “Beyond simple conversational interfaces… secure, programmable agents”.

O sea: no es “pregúntale a la IA”, sino “crea agentes que ejecuten tareas dentro de un marco controlado”.

En resumen: Foundry está intentando colocarse donde está el valor real para los estudios: no en “hacer magia”, sino en domar la magia. Hacerla integrable, trazable, segura y repetible. Veremos si lo consiguen..

3. Primeras impresiones

Dicho todo esto, lo importante no es la nota de prensa. Lo importante es: ¿qué pasa cuando lo instalas y te pones a tocarlo?

Lo primero: No es otro ComfyUi

Yo esperaba un calco a Comfy pero se siente diferente. Tardas porco en darte cuenta que está pensado más como un sistema agéntico. Entiendo que la estrategia de The Foundry será ir implementando todos los controles a través embedings que agradecemos los que buscamos una capa extra de control en las generaciones.

De momento lo poco que he podido probar en la parte de generación de imagen lo he hecho a traves de créditos de API y me ha recordado mucho a la forma de trabajar con API nodes de Comfy, acceso a los modelos mas recientes y comerciales pero sin el control de los open weights.

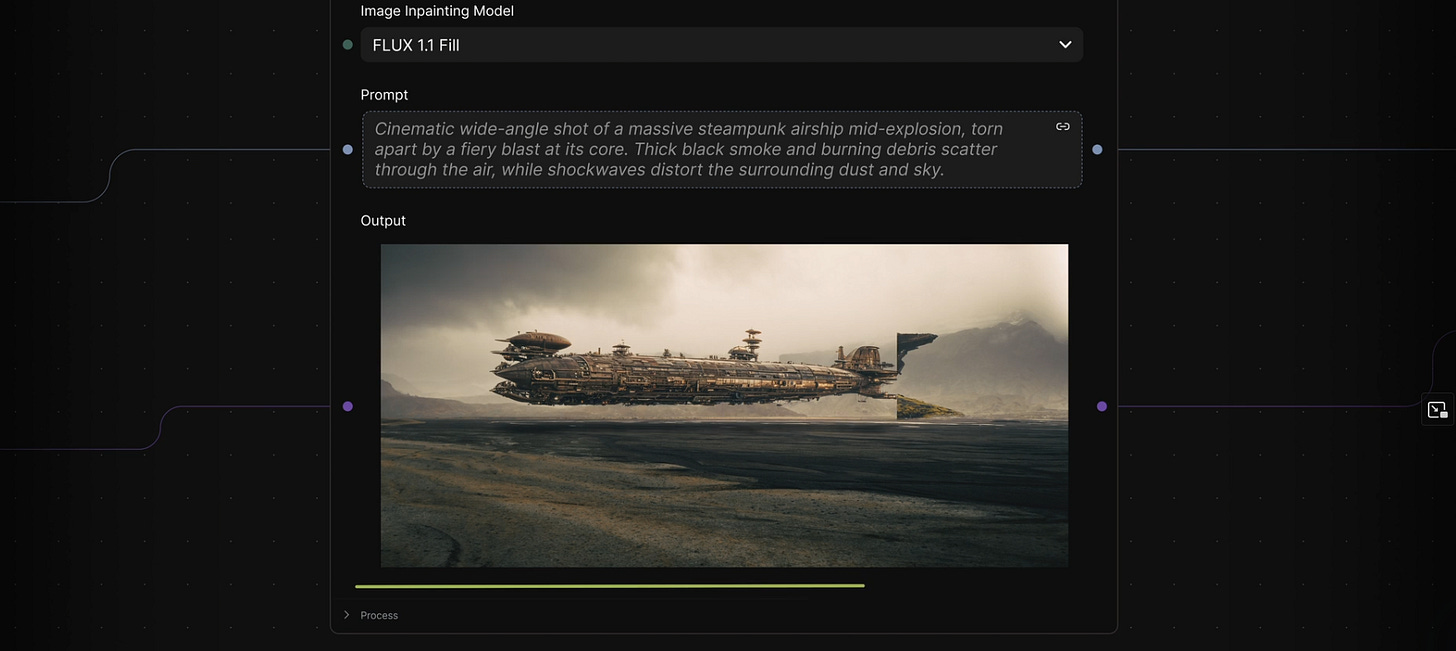

Me he centrado más en construir un mini agente súper simple. Entrada de prompt muy sencillo en castellano, traductor a inglés y a través del agente controlado por API de OpenAI generar un prompt curado con unas reglas de promting para nano banana:

Prompt incial

“Desde un plano frontal un coche está volando tras haber saltado en mitad de un puente colgante al estilo brooklyn bridge. El puente se acaba de romper tras una explosión y al fondo vemos nueva york.”

Promt de salida:

“Subject: A red sports car

Composition: Close-up frontal shot

Action: The car is flying through the air after being propelled by an explosion.

Setting/Location: A suspension bridge resembling the Brooklyn Bridge, with New York City in the background.

Style: Cinematic, action-packed scene.

Camera lens, shadow, and lighting details: Dynamic lighting with fiery tones from the explosion, natural daylight illuminating the cityscape.”

Imagen:

A decir verdad no he conseguido que Gemini 3 Pro Imaga aka Nano Banana me devolviera la generación y me he pasado a Flux 2.0, viva Black Forest Labs!

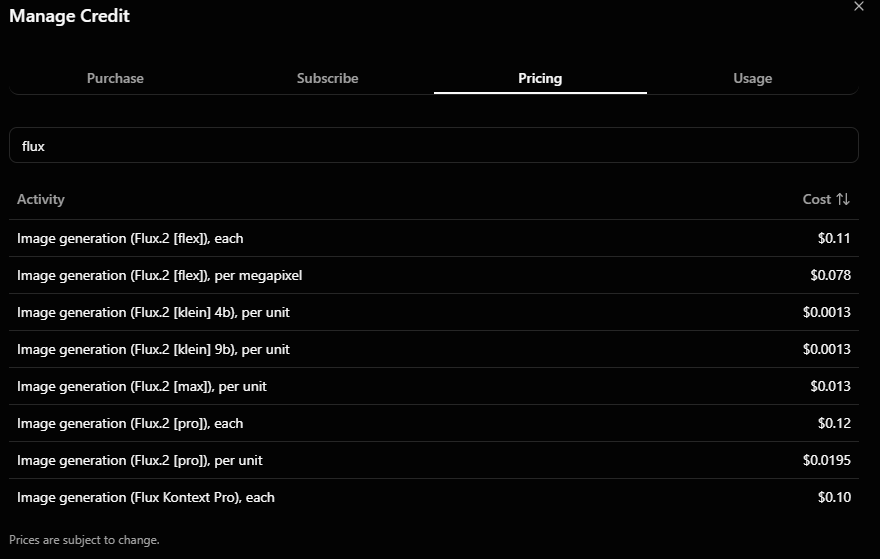

He decir que tras un rato generando imágenes me han parecido un poco caros los Api credits. Estos días ire probando modelos open source e insistiré un poco con Nano Banana….

Aquí los precios de Flux:

Mi conclusión por ahora

A día de hoy, no diría “ya está, ComfyUI tiene competencia directa”.

Pero sí diría algo que para mí es más importante:

Foundry está intentando construir la infraestructura que hace falta para que la IA deje de ser experimento y se convierta en pipeline.

Y esa batalla —la de la infraestructura— es la que de verdad decide quién gana a medio plazo.

Si lo estáis probando también, contadme vuestras sensaciones. Abrazos familia!